Sztuczna inteligencja (AI) w tradingu: szansa czy wielki scam?

Przy wzroście popularności modeli LLM, takich jak ChatGPT czy Claude, rozgłos zdobywali też oszuści, obiecujący zarabianie na tradingu dzięki wykorzystaniu AI. Wiele osób początkujących, które dodatkowo niekoniecznie zdają sobie sprawę z tego, czym w ogóle jest sztuczna inteligencja, może być zachęconych tego typu sloganami. Jednak czy w przypadku pojedynczych inwestorów, AI naprawdę może być użyteczna na giełdzie?

Oszustwa “na AI” pozbawiły inwestorów milionów dolarów

“1% dziennie bez ryzyka” czy “10% dziennie” – często w taki sposób zachęca się dzisiaj w internecie do inwestowania w systemy tradingowe oparte na sztucznej inteligencji. W przypadku tradingu kryptowalut, według FBI, oszuści celują często w grupę wiekową 30-49 lat i ludzi pobieżnie zaznajomionych z finansami, rynkami krypto i technologią AI. Na tyle zaznajomionych, by dać się nabrać, rozpoznając potencjalne korzyści wykorzystania nowinek technicznych i jednocześnie nie mających na ten temat żadnej większej wiedzy, która pozwoliłaby im podważać sens inwestowania w “magiczne systemy”.

Według notki CFTC, tego typu oszustwa mają się dobrze i w przeszłości pozwoliły zarobić złodziejom dziesiątki milionów dolarów. Dzięki obietnicom szybkich, pasywnych zysków, a niekiedy także dzięki technologii DeepFake i podszywaniu się pod czołowe firmy technologiczne, takie jak OpenAI, czy celebrytów pokroju Elona Muska.

Na tym etapie artykułu łatwo byłoby uznać, że tego typu oszustwa są bardzo łatwe do rozpoznania i sprawa nie jest warta omówienia. Temat, jednakże, jest zdecydowanie głębszy i dotyczy także legalnie działających firm, które potrafią utrzymywać się na rynku wiele lat. Zwykle nie obiecują kosmicznych zwrotów. Zamiast tego, chwalą się wysoką skutecznością i oferują klientom zyskanie przewagi nad innymi, dzięki wykorzystaniu sztucznej inteligencji. Tak samo kończy się stratą pieniędzy, ponieważ AI, wbrew domysłom ogółu, wcale nie jest na giełdzie tak użyteczna i tak prosta do zaimplementowania, jakby się wydawało.

Overfitting, czyli największy problem AI na rynkach finansowych

Na początek trzeba mieć świadomość, że słowo “AI”, które dzisiaj wykorzystuje się jako marketingowy slogan, tak naprawdę jest “parasolem”, obejmującym bardzo wiele różnych narzędzi. Jest to inaczej szerokie pojęcie, pod którym znajdziemy różne technologie, umożliwiające komputerowi wykonywanie zadań, które dotychczas wymagały ludzkiej inteligencji.

Zamiast omawiać poszczególne jej rodzaje, warto jednak pochylić się nad największym problemem dotyczącym wykorzystania AI na giełdzie – wrażliwością na tzw. “Overfitting”.

-

Źródło: https://miro.medium.com/v2/resize:fit:1125/1*_7OPgojau8hkiPUiHoGK_w.png

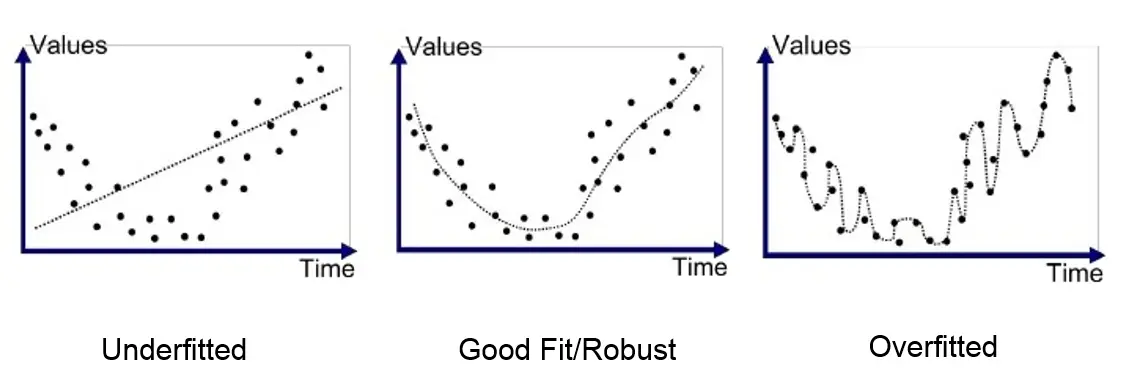

Łatwo zrozumieć to pojęcie na przykładzie powyższego obrazka.

W pierwszym przykładzie od lewej widać zbiór punktów, które mają być objaśnione przez nasz model, a także linię reprezentującą ten model. To przykład “Underfittingu”, w którym algorytm niewystarczająco opisuje dane. W przykładzie środkowym linia modelu dobrze opisuje punkty na wykresie, podczas gdy przykład ostatni – Overfitting, obrazuje dane treningowe, do których model dopasował się „za bardzo”.

Żeby jeszcze bardziej to uprościć, posłużymy się przykładem algorytmów rozpoznających zwierzęta na zdjęciach.

-

Źródło: Wikipedia

By rozpoznać kota na przypadkowej fotografii, program musi znaleźć punkty wspólne kotów widocznych na różnych zdjęciach, takie jak kształt oczu, nosa, uszu i tak dalej. Z perspektywy algorytmu, są to oczywiście pewne właściwości statystyczne. W ten sposób, po treningu na dużych zbiorach danych, model będzie w stanie rozpoznawać koty na zdjęciach, których nie widział nigdy wcześniej. Jednak jeśli dojdzie do Overfittingu na zdjęciu powyżej, algorytm uzna, że nieistotne detale z tego zdjęcia, takie jak szczegóły umaszczenia tego konkretnego kota, są konieczne do rozpoznania zwierzęcia na fotografii.

Model nie będzie miał umiejętności generalizacji, którą my, jako ludzie, posiadamy naturalnie i będzie w stanie rozpoznać kota na… zdjęciu, na którym został wytrenowany i niewiele ponadto.

To, że AI dostrzega więcej detali, niekoniecznie jest zaletą

Dlaczego wysoka dokładność jest ogromnym problemem w kontekście handlu na rynkach finansowych?

Ponieważ dane generowane przez rynek zawierają bardzo dużo “szumu” – przypadkowych wahań cen, które nie mają żadnej wartości w procesie przewidywania przyszłych cen. Algorytm, chcąc objaśnić badane informacje, będzie modelował ten szum i na danych testowych, na których został wytrenowany, osiągnie nieprawdopodobną skuteczność. Jednak kiedy pokażemy mu nowe dane, z którymi nie miał do czynienia nigdy wcześniej, przestanie mieć jakąkolwiek wartość, ponieważ opiera się na przypadkowych wahaniach, które już się nie powtórzą.

W finansach Overfitting jest ogromnym problemem, dlatego Marcos López de Prado w swojej książce “Advances in Financial Machine Learning” opisuje proces pisania i trenowania algorytmów uczenia maszynowego na rynkach, jako zadanie nie tyle dla jednego człowieka, co dla całych zespołów doświadczonych badaczy, z których każdy pokrywa inny aspekt modelu.

Reasumując, bardzo łatwo ulec wrażeniu, że algorytmy AI “widzą więcej” niż ludzie, dlatego powinny być użyteczne w tradingu. W wywoływaniu tego wrażenia aktywnie pomagają też różnego rodzaju “eksperci”, którzy, mimo iż sami nie mają wiele wspólnego ze stosowaniem tych technologii, straszą publikę superinteligentnymi maszynami. Kiedy znowu usłyszymy takie opinie, a następnie zobaczymy reklamy obiecujące nam zarabianie na giełdzie dzięki AI, dobrze jest pamiętać, że na rynkach kryptowalut, akcji czy Forex, „więcej”, nie zawsze znaczy “lepiej”, a szanse na to, że reklamowany w internecie system faktycznie zarabia, są bliskie zeru.